Článek

Článek si také můžete poslechnout v audioverzi.

„Tímto dávám najevo, že Facebook nemá právo používat moje informace a fotografie!“ píšou lidé čas od času na své facebookové nebo instagramové zdi. Zatím se vždy jednalo o hoax, tedy nepravdivou fámu. Různé verze tohoto „prohlášení“ kolují po sociálních sítích už od roku 2012 a nemají pochopitelně žádný účinek. Snad kromě toho, že tím uživatelé světu sdělili, že jsou schopni skočit na virální špek.

Proto bude pro řadu uživatelů matoucí, že aktuální výzva – na první pohled velmi podobná – falešná není. Pochází přímo od firmy Meta a vychází z pokusu kalifornské firmy vyhovět evropským směrnicím.

„Cítíme odpovědnost za vytvoření umělé inteligence, která nebude Evropanům vnucována, ale bude skutečně vytvořena pro ně. Abychom toho dosáhli a zároveň respektovali volbu evropských uživatelů, považujeme za správné je informovat o našich plánech a dát jim možnost nám říct, jestli se (na trénování umělé inteligence) nechtějí podílet,“ uvedla firma Meta, která provozuje sociální sítě Facebook, Instagram a Threads. „Poskytli jsme proto uživatelům výrazné ovládací prvky, aby se mohli z tohoto trénování odhlásit, pokud si to přejí.“

Jak se odhlásit?

Ty „výrazné ovládací prvky“ zřejmě odkazují na notifikace, které Meta svým uživatelům rozeslala. V klasickém nastavení jsou naopak docela skryté:

- Na Facebooku klikněte vpravo nahoře na svou profilovku.

- Zvolte Nastavení a soukromí.

- Vyberte Centrum soukromí.

- V menu vyberte Další zásady a články.

- Poté klikněte na Jak Meta využívá informace pro modely a funkce generativní Al (zde).

- V tomto dvoustránkovém textu pak ke konci klikněte na odkaz právo vznést námitku.

- Dostanete se na stránku nápovědy, kde musíte vyplnit svou zemi a e-mailovou adresu a vypsat slovy námitku.

„Sdělte nám prosím, jaký má na vás toto zpracovávání dopad.“

Co do námitky napíšete, to je samozřejmě na vás. Je to mimochodem skvělá příležitost zapojit umělou inteligenci. Je ostatně nepravděpodobné, že by na druhé straně váš text četl živý člověk.

Následně ještě musíte potvrdit e-mailovou adresu, do schránky vám přijde šestimístný kód, který následně přepíšete do druhého kroku formuláře. A pak počkáte na schválení. To je, jak se zdá, plně automatické a uživatelé hlásí, že firma jejich žádosti vyhověla obratem.

Meta pozastavila své plány

Původním plánem firmy Meta bylo začít trénování už tento měsíc. Přestože námitku lze stále poslat (není jasné, kdy nebo zda Facebook tuto možnost zruší), situace se v posledních dnech změnila. Irský úřad na ochranu dat (Irish Data Protection Commission) totiž v pátek 14. června firmě doručil „žádost o odložení trénování modelu“.

Rakouská nezisková organizace Noyb, která si na postup firmy Meta stěžovala v 11 zemích EU, to slaví jako své předběžné vítězství: „Úřad pro ochranu osobních údajů oznámil, že se firma Meta zavázala, že nebude zpracovávat údaje uživatelů z EU/EHP pro blíže nespecifikovanou umělou inteligenci. Dříve Meta tvrdila, že na tom má oprávněný zájem.“

Společnost Meta ve své aktualizované tiskové zprávě neskrývá zklamání: „Je to krok zpět pro evropské inovace a hospodářskou soutěž v oblasti vývoje umělé inteligence a další zpoždění v tom, aby lidé v Evropě mohli těžit z výhod umělé inteligence. Jsme i nadále přesvědčeni, že náš přístup je v souladu s evropskými zákony a předpisy. Trénování AI není ojedinělé a jsme v tom transparentnější než mnoho našich kolegů v oboru.“

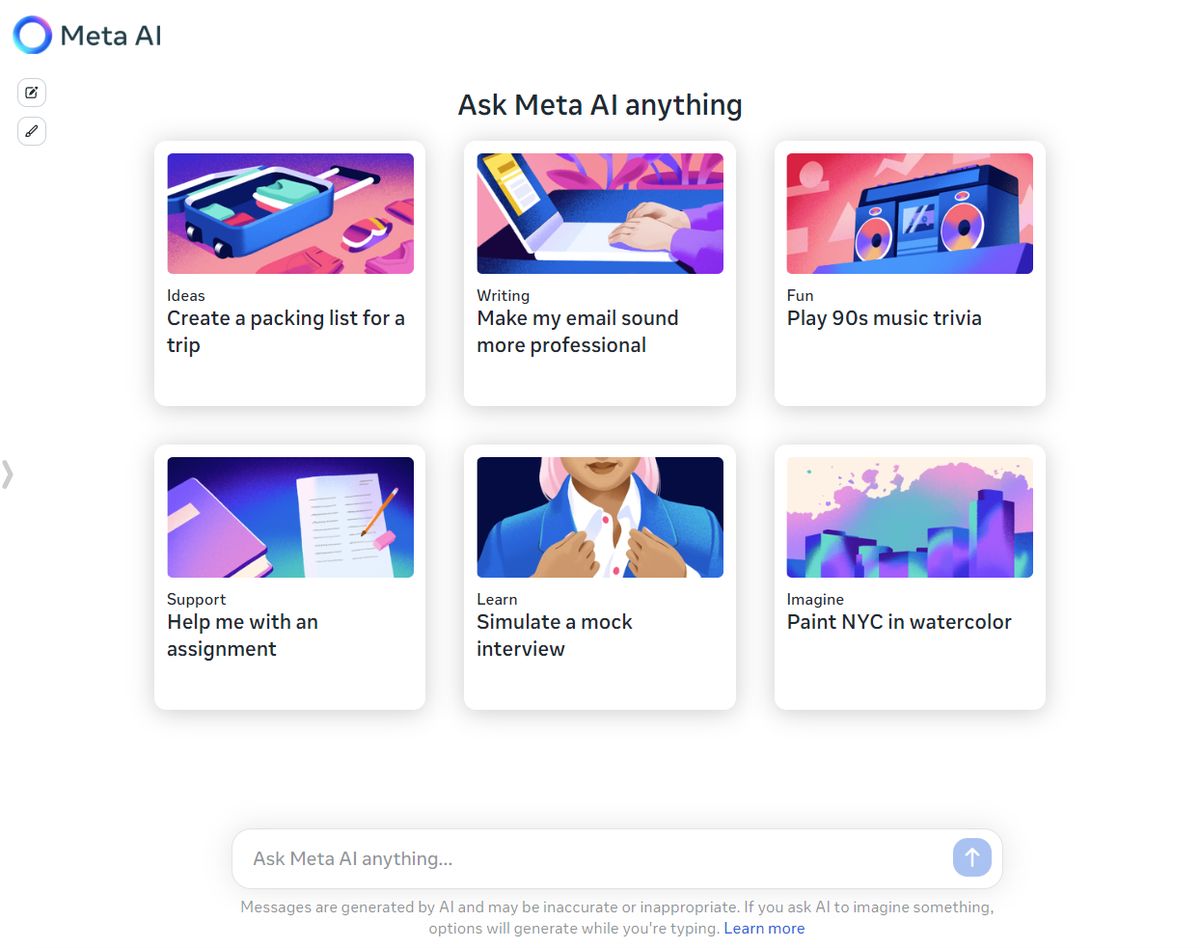

Ukázky Meta AI: Chatbot funguje i bez přihlášení. Ale jen z některých zemí.

Na základě toho také firma odsouvá spuštění svého asistenta Meta AI v Evropě na neurčito.

Max Schrems, ředitel neziskovky Noyb, v tom vidí kolektivní trest: „Když Evropané trvají na svých právech, nedostanou naše nové produkty. Ale Meta má samozřejmě možnost spustit v Evropě trénování umělé inteligence na základě skutečného souhlasu uživatele. Jen se rozhodla, že to neudělá.“

Skutečným souhlasem Schrems myslí tzv. „opt-in“, tedy aktivní a explicitní souhlas každého uživatele. V současné podobě Meta využívá tzv. „opt-out“, který naopak předpokládá automatický souhlas všech uživatelů, kteří aktivně nevyjádřili nesouhlas.

Jiní se vůbec neptali

Společnost Meta má nicméně pravdu v tom, že v porovnání s konkurencí je jejich přístup relativně transparentní. Generativní umělá inteligence si s sebou už od začátku současné vlny v roce 2022 táhne škraloup v podobě eticky sporného trénování na (obvykle) veřejně dostupných datech.

Zcela jasně je to vidět u obrazových dat. Vědci například ukázali, že pomocí generátoru Stable Diffusion lze velmi snadno dosáhnout generování snímků, které jsou na první pohled velmi podobné těm, na němž se neuronová síť učila. Ještě nedávno s tím měla problém i služba Midjourney, ve firmě dokonce koloval seznam „umělců, které umí Midjourney napodobit“. Skupina umělců se s firmami, jež služby provozují, soudí.

Nahoře jsou obrázky vygenerované neuronovou sítí Stable Diffusion, dole pak obrázky, které byly součástí trénovacích dat v databázi LAION.

Také generátory textů, založené na tzv. velkých jazykových modelech, ke svému fungování potřebují velké množství textů. Firmy obvykle nezveřejňují, kde tyto texty sehnaly, ale například model GPT-4 od OpenAI se zjevně učil i na článcích redaktorů The New York Times.

Uživatel mohl – jak ukázala žaloba The New York Times – pomocí ChatGPT obejít zabezpečení a dostat se k placenému obsahu novin.

Také OpenAI (a jejich partner Microsoft) proto čelí žalobám kvůli vykrádání obsahu. Videomodel Sora – pro veřejnost zatím nepřístupný – vyvolal překvapení laické i odborné veřejnosti tím, jak detailní videozáběry umí generovat… Existuje ale podezření, že se trénoval na velkém množství videoklipů z konkurenční služby YouTube. A model GPT-4 byl zase zřejmě vytrénován i pomocí přepsaných YouTube videí.

A když už někdo přistoupí k trénování údajně zodpovědně a eticky – jako třeba firma Adobe, která svůj generátor obrázků Firefly údajně cvičila poctivě na k tomu zakoupených obrazech –, ukáže se, že si při trénování pro změnu dopomáhal obrázky generovanými konkurenční službou Midjourney…

Jinými slovy, v oblasti „výcviku“ modelů generativní umělé inteligence mají máslo na hlavě skoro všichni. A pravděpodobně to bude ještě chvíli trvat, než na základě výsledků soudních i mimosoudních sporů dojde k nějakému obecně uznávanému řešení. Evropské regulace jsou v tom napřed. Což může v praxi paradoxně působit jako brzda bezbřehých inovací.